近年来,情感识别(Emotion Recognition, ER)作为人工智能的关键技术之一,在语音助手、智能家居、自动驾驶等多种场景中得到了广泛的应用。人们在生活中,会通过语音语调、面部表情、肢体动作或者文本等信息传递自身的情感信息。我们可以通过以上四种模态之一,或是多模态数据,来实现情感识别过程。本文将依次对上述方法进行介绍和剖析,揭开情感识别神秘的面纱;而后对多模态情感识别进行较详细的描述。

一、语音情感识别

语音情感识别技术是语音信息处理和人机交互领域的研究热点之一,它通过分析和识别语音信号中情感信息来判断说话人的情感状态,使机器具备与人类一样的情感感知和处理能力。研究者利用传统机器学习作为分类器,构建起语音情感识别系统。近年来,深度学习被引入到语音情感识别处理中,提高了语音情感识别的识别性能。因此,研究识别性能更优的基于深度学习的语音情感识别模型对促进语音情感识别领域的发展具有重要意义。

二、基于视觉的情感识别

人脸表情是最直接、最有效的情感识别模式。它有很多人机交互方面的应用,例如疲劳驾驶检测和手机端实时表情识别。早在20世纪Ekman等专家就通过跨文化调研提出了七类基础表情,分别是生气,害怕,厌恶,开心,悲伤,惊讶以及中立。然而不断的研究发现这七类基本表情并不能完全涵盖人们在日常生活中所表露的情感。针对该问题,2014年在PNAS上发表的一篇文章研究提出了符合表情的概念,并且指出多个离散的基础表情能结合在一起从而形成复合表情。例如当人们遇到意外的惊喜时,应该是既开心又惊讶的。

人脸表情识别的具体应用如人机交互,驾驶员疲劳检测,医疗,谎言检测等。整个人脸表情识别的研究是跟随人脸识别的发展而发展的,人脸识别领域比较好的方法会同样适用于表情识别(这里主要是指静态图像人脸表情识别,毕竟是个分类问题,跟人脸识别类似)。该综述从算法和数据库两方面调研了人脸表情识别领域的进展。在数据库方面,表情识别逐渐从传统的实验室统一控制下的小样本量数据库转移到了现实生活中的多样化大规模数据库。在算法方面,传统的手工设计特征乃至浅层学习特征也不再能很好地适应现实世界中种种与表情无关的干扰因素,例如光照变换,不同的头部姿态以及面部阻挡。于是越来越多的研究开始将深度学习技术运用到了人脸表情识别之中,来解决上述问题。

三、肢体动作的情感识别

随着对情感计算及智能人机交互研究的不断深入,肢体动作识别也开始作为获取情感的一种手段被用于情感识别中;人的肢体动作包含:面部、躯干、四肢、腰身点、线、面上的动作。其中,躯干包含肩、胸、背、腹、臂、腰等;四肢包含臂、手、膝、腿、脚等,人们运用肢体动作的变换来表达情感,是能够被大众所接受的演绎情感方式。

表1 情感与肢体动作对应表

|

情感 |

身体姿势和运动 |

|

高兴 |

各种无意的运动,高兴地跳跃、跳舞、鼓掌、跺脚、大笑时点头,过分大笑时身体前仰后合,身体颤动或笑得直不起腰,身体保持异常兴奋和头部竖直 |

|

悲伤 |

无运动、被动的,头耷拉在收缩的胸前 |

|

骄傲 |

头部和身体异常兴奋 |

|

害羞 |

将整个身体转过去,尤其是脸;逃避,俯身,笨拙、紧张地运动 |

|

害怕 |

头部下沉到肩膀间,无运动或者蹲下 |

|

恐怖 |

痉挛性运动,手交替性的抓紧,张开并伴随着颤动性的运动,手臂在头部上方大幅度运动,转身或退缩,手臂做推开状,肩膀提起并且手臂弯曲地压在身体侧面或胸前 |

|

生气 |

身体发抖,意图猛推或攻击,将无生命的物体猛掷到地上,姿势变得无目的性或疯狂,来回走动,摇动拳头,头部竖直,胸部展开,双脚紧贴在地面上,单肘或双肘成直角或手臂津贴身体侧面,拳头握瑾,肩膀呈方形 |

|

嫌恶 |

意图推开或保护自己,吐痰,手臂紧压在身体侧面,肩膀入恐怖般提起 |

|

轻蔑 |

转身,呈满不在乎状 |

但相对于语音和人脸表情变化来说,姿态变化的规律性较难获取,但由于人的姿态变化会使情感表述更加生动,数据不易获取,表现更难察觉,通过协同,更有利于分析情感状态。

四、基于文本的情感识别

文本情感分析(Sentiment Analysis)是指利用自然语言处理和文本挖掘技术,对带有情感色彩的主观性文本进行分析、处理和抽取的过程。目前,文本情感分析研究涵盖了包括自然语言处理、文本挖掘、信息检索、信息抽取、机器学习和本体学等多个领域,得到了许多学者以及研究机构的关注,近几年持续成为自然语言处理和文本挖掘领域研究的热点问题之一。情感分析任务按其分析的粒度可以分为篇章级,句子级,词或短语级;按其处理文本的类别可分为基于产品评论的情感分析和基于新闻评论的情感分析;按其研究的任务类型,可分为情感分类,情感检索和情感抽取等子问题。文本情感分析的基本流程包括从原始文本爬取,文本预处理,语料库和情感词库构建以及情感分析结果等全流程。由于文本原始素材爬取,分词等预处理技术已比较成熟,本文接下来将通过情感分析的主要任务情感分类,情感检索,情感抽取问题来分析和阐述已有的相关研究工作。

五、多模态情感识别分析

1.背景和意义

情感是通过多种模态的形式进行表达的:情感涉及主观经历、生理反应和行为反应;每个人都有自己的主观感受,身体会出现一系列的生理反应,并且通过表情、言语和肢体动作等行为方式表示情感;多模态情感识别就是通过这些生理反应和行为反应(即多模态信息)来识别和预测情感; 情感是通过多种模态的形式进行表达的:人们在高兴时说话节奏欢快,表现在说话的音调和语速上,同时面部会微笑,眯眼,此时语音和表情同时表达出高兴的情感状态;当一个人难过时,往往不会怎么说话,情感识别难以单靠语音单模态信息,难过体现在表情上往往伴随着面部嘴角下垂、皱眉等。多模态情感识别:情感识别分析语音信号、视觉信号和生理信号来识别人的情感状态,利用多通道情感信息之间的互补性来提高情感识别的准确率。单模态情感识别鲁棒性不足、识别率不高:当人类主观上对情感信号加以掩饰或者单一通道的情感信号受到其它信号的影响时,情感识别性能将会明显下降,如面部表情容易被遮挡、语音容易受噪声干扰。

2.主要方法

(1)多模态情感融合方法

每个模态都有一个向量,都提取出来,会形成超大维的矢量;特征层融合往往会面临着特征维数过大问题,故需采取一定的措施对融合后的特征进行降维,避免冗余甚至引发“维数灾难”;主成分分析方法是一种典型的降维方法,根据各类特征对情感识别的重要性进行筛选,去除冗余信息。

(2)多核融合学习

每个模态构建一个核,试图发现最优的融合多模态特征的方式;核替换原来的特征参数;把低维的数据映射到高维的特征空间(核空间),并通过核函数在核空间进行特征融合

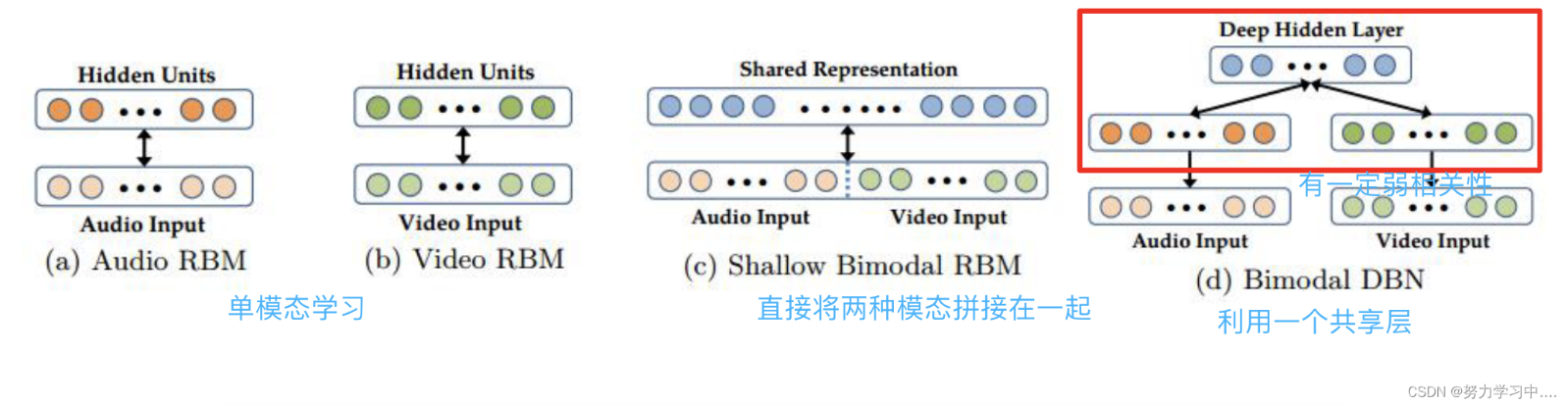

(3)深度神经网络

六、总结与展望

1.语料

l 语料很重要,但目前规模较小;

l 采集整理工作难;

l 关注跨数据库展现(如考虑文化、语种差异)。

2.语音情感特征

l 找新特征,获取更高识别率;

l 多特征融合(不能通过向量特征拼接形成高维度的形式);

l 在高维情况下分类器的泛化性能反而更弱,要针对性进行特征降维和选择。

3.语义理解

l 利用语义的语音情感识别,如文字、声音线索、视频线索;

l 语音语义识别同情感识别相结合。

(2022-10-15 10:10:05)

- 政府

- 上级指导单位